Publikace detail

Battle royale optimizer for training multi-layer perceptron

Autoři:

Agahian Saeid | Akan Taymaz

Rok: 2022

Druh publikace: článek v odborném periodiku

Název zdroje: Evolving Systems

Název nakladatele: Springer

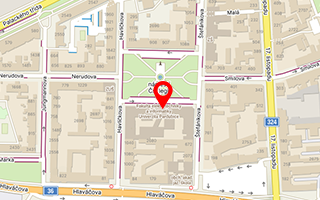

Místo vydání: Vídeň

Strana od-do: nestránkováno